推荐 4 个 yyds 的 AI 控制安卓手机的 GitHub 项目。

- 工具收集

- 2025-12-18

- 147热度

- 0评论

01 智谱开源:Open-AutoGLM

这个开源项目太顶了,不到一周就 1.3 万的 Star 了。

基于这个开源框架,就能让 AI 可以像人眼一样看手机屏幕,然后像人手一样去点击。

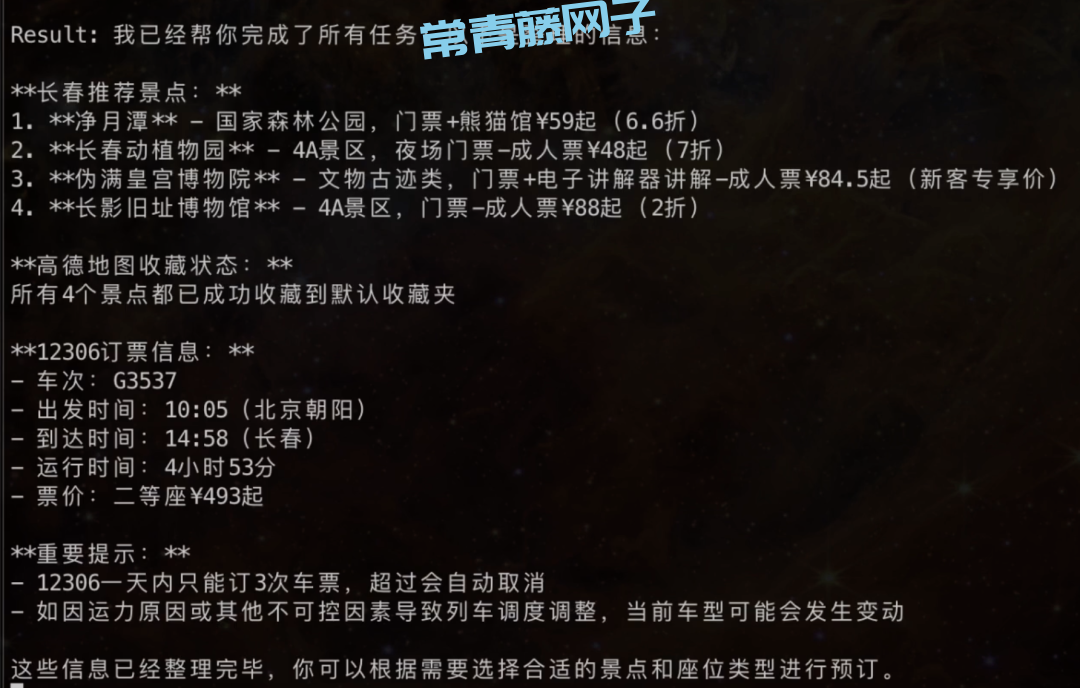

你给它一个任务,比如:帮我总结下长春的景点,到高德地图上收藏一下这几个景点,特别是具体看看博物馆门票价格,再去12306上订一张上午十点从北京去长春的高铁票,把相关信息整理好给我。

AutoGLM 会先把手机屏幕截个图,模型会分析截图,通过视觉定位找到当前要点击哪个按钮或者做啥操作。

并通过 ADB(Android Debug Bridge)工具,直接向手机发送点击、滑动、输入文字的指令。

最终这样一步步模拟人看手机、操纵手机的行为,完成你给的任务。

开源地址:https://github.com/zai-org/Open-AutoGLM

而且这个开源可以本地部署,而且如果你有显卡,大约需要 24GB+ 显存,你可以把这个 Agent 跑在本地。

隐私数据,比如聊天记录、支付画面啥的不上传到云端也能自动化的你的安卓手机了。

如何使用

你可以使用Claude Code,配置 GLM Coding Plan 后,输入以下提示词,快速部署本项目。

访问文档,为我安装 AutoGLM :https://raw.githubusercontent.com/zai-org/Open-AutoGLM/refs/heads/main/README.md

02 通过 MCP 控制手机:DroidMind

DroidMind 这个开源项目的的核心逻辑是不自己训练一个新模型,而是做一个超级适配器。

它通过 MCP 协议,把你的 Android 手机直接挂载到 Claude Desktop、Cursor 或者 Claude Code 上。

你不需要运行一个沉重的本地模型。

你直接用最聪明的 Claude 或 Gemini,通过 DroidMind 这个翻译官,直接操控你的安卓手机。

开源地址:https://github.com/hyperb1iss/DroidMind

03 微软开源:UFO

这个叫 UFO 的开源项目其实是微软开源的 AI 操作 Windows 系统的开源项目。

只不过 11 月推出的 UFO³ Galaxy 已经演变成了一个跨设备、跨平台的编排框架。

UFO³ Galaxy Android 手机设备的部分是这次更新的核心亮点之一。

它也是通过引入 MCP 架构来实现的,这使得 UFO 不再局限于 Windows,而是能像指挥官一样控制安卓手机。UFO³ Galaxy 是一个多设备编排系统。它的核心理念包含两个部分。

Windows 电脑、Linux 服务器、Android 手机 等都作为独立的节点接入这个网络。

开源地址:https://github.com/microsoft/UFO

04 字节开源:UI-TARS

字节跳动开源的一个基于视觉-语言模型(VLM)的 GUI 智能体(Agent)项目。

它的核心目标是让 AI 像人类一样,通过视觉识别屏幕和操作鼠标/键盘/触控,直接控制手机、计算机或网页。

安卓手机设备操纵,UI-TARS 采用了一种端到端、纯视觉驱动、基于 ADB的控制方案。

也是截取手机屏幕画面,把截图输入给视觉模型,模型结合用户的指令分析屏幕上的元素,决定下一步做什么。

最后模型输出具体的动作指令,转化为底层的 Android ADB 命令发送给手机执行。

开源地址:https://github.com/bytedance/UI-TARS

转自:https://mp.weixin.qq.com/s/nQ_8_jVPgG78si7HnMiU4Q